字数 4132,阅读大约需 21 分钟

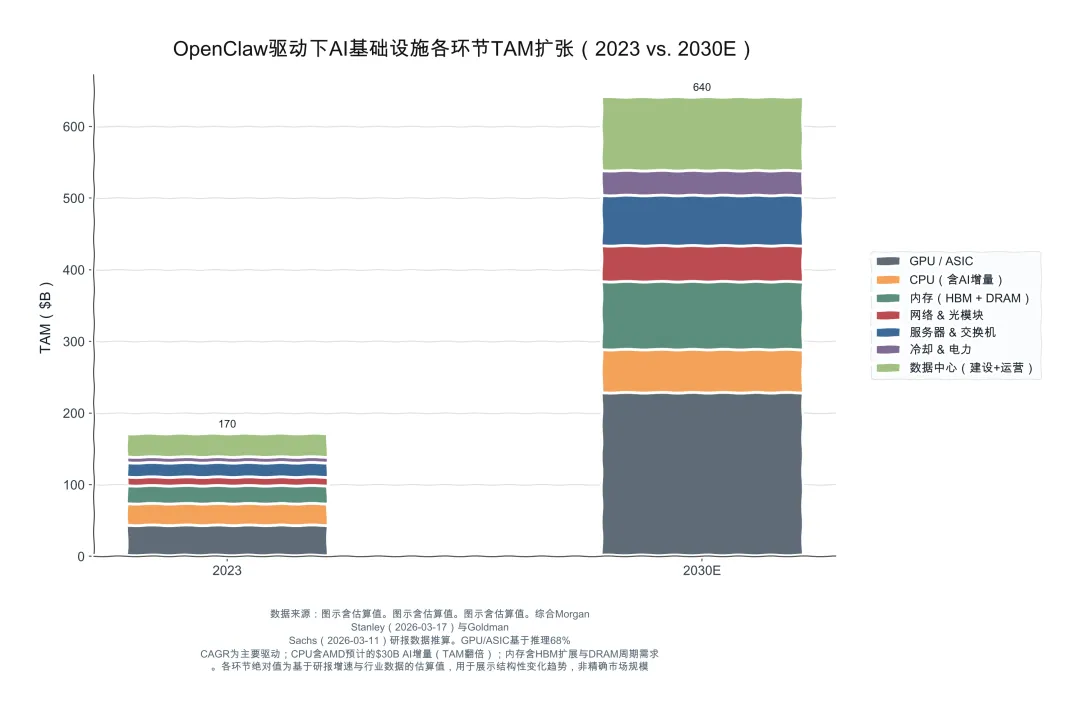

OpenAI的年化收入从2023年的20亿美元跃升年的200亿美元,增速超过10倍。同期,周token使用量增长了约2,200%。这组数字背后不是训练芯片的故事,而是推理需求的爆发。OpenClaw通过系统级访问和24/7连续服务,正在把AI从被动问答转变为主动执行,推理芯片需求增速达到68% CAGR(2023-2030年),基础设施需求进入全新量级。

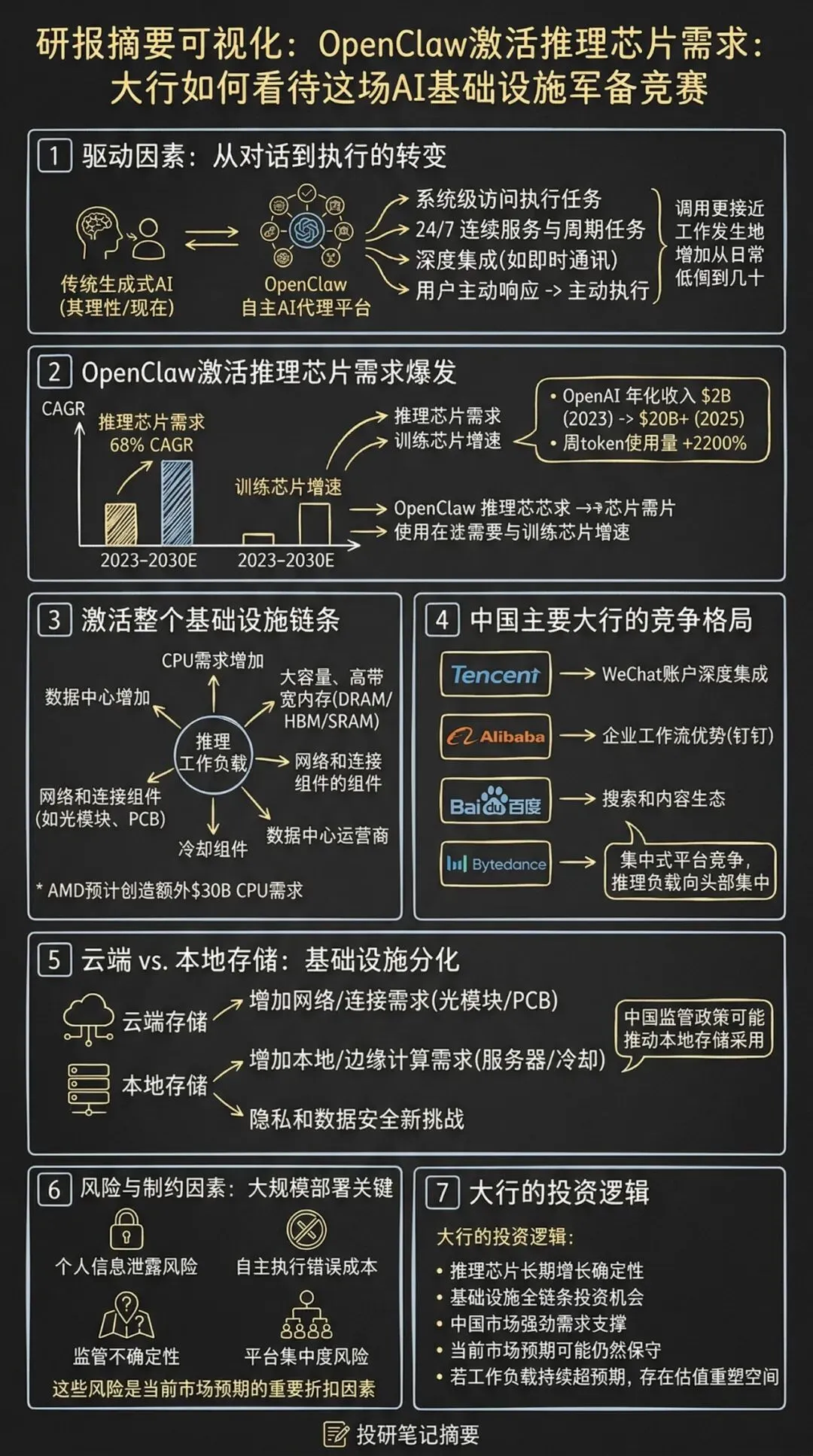

从对话到执行:应用范式的根本转变

OpenClaw是一个开源自主AI代理平台,运行在用户本地设备上。它通过持久化内存、工具执行和与本地环境及消息应用的深度集成,能够执行真实世界的任务——回复邮件、从网络抓取数据、运行shell命令、订购配送。

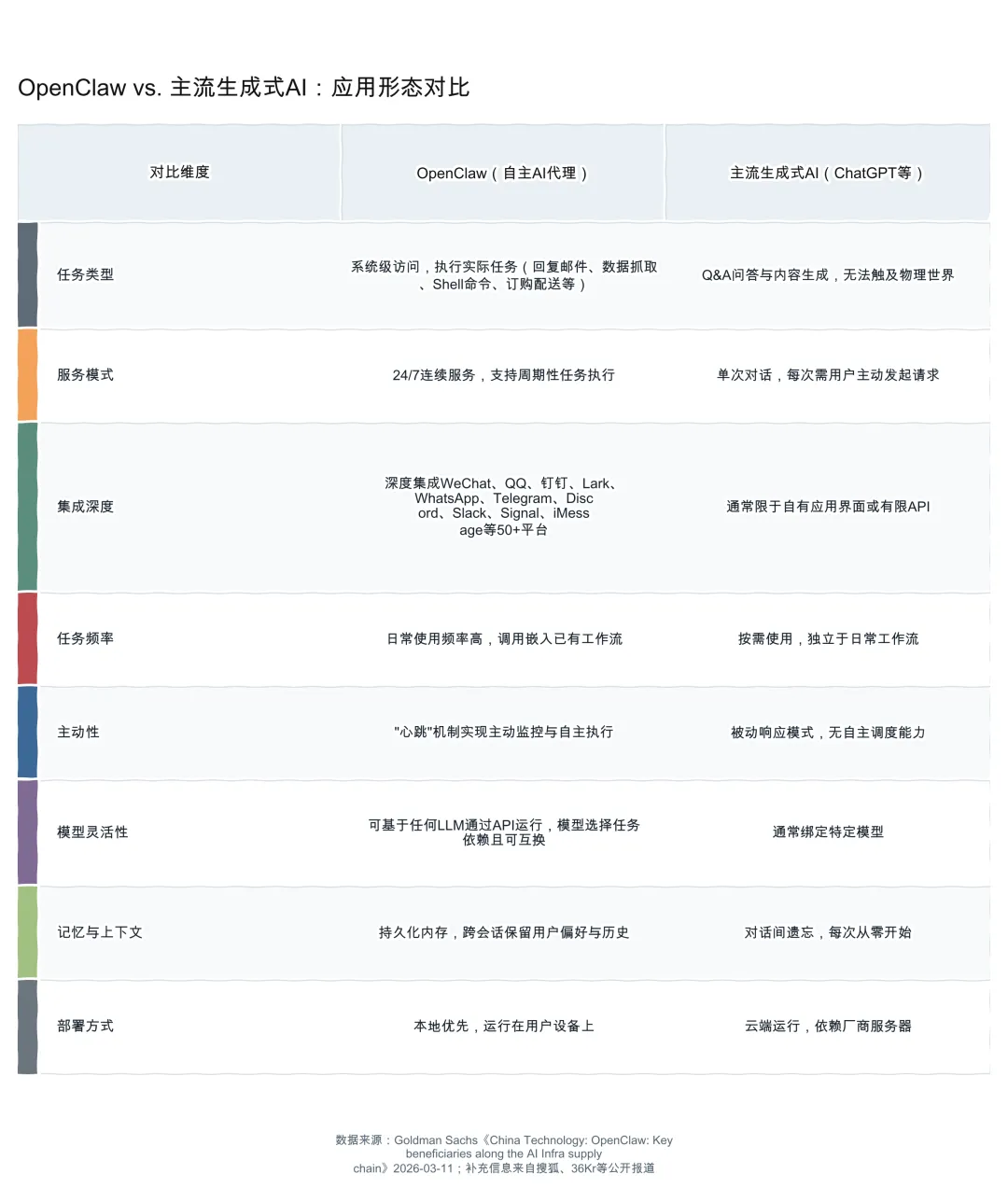

高盛的对比框架清晰地勾勒出这种差异。传统生成式AI主要限于Q&A和内容生成,OpenClaw则可以通过系统级访问执行实际任务。这不只是功能层面的增量改进,而是应用范式的根本转变。

服务连续性是第二个关键差异。OpenClaw支持24/7连续服务和周期性任务执行,配备"心跳"机制实现主动监控和自主执行。传统对话式AI是被动响应模式——用户每次都要主动发起请求。摩根士丹利指出,这导致"日常使用频率上升,因为调用更接近工作已经发生的地方"。单个用户的任务调用频率从每天一两次跃升至数十次甚至更高。

集成深度则是第三个维度。OpenClaw与WhatsApp、Telegram、Discord、Slack、Signal、iMessage等消息平台深度集成,同时支持WeChat、QQ、钉钉、Lark等中国主流应用。这种高度集成大幅降低了用户摩擦——AI应用不再是独立工具,而是嵌入到用户已有的工作流中。

模型灵活性也值得注意。OpenClaw可以基于任何LLM通过API运行,而传统生成式AI通常绑定特定模型。摩根士丹利指出,在这种架构下,"模型选择可能变得更加任务依赖和互换"。对芯片供应商而言,这削弱了单一厂商的锁定效应,但整体推理工作负载的增长仍然是确定的。

中国主要AI平台对这一转变的快速响应验证了市场潜力。腾讯推出了QClaw,可在Mac或Windows PC上本地安装,并与个人WeChat账户深度集成。高盛的研报指出,阿里、百度、字节、Kimi、Minimax等也相继推出了自己的OpenClaw服务。这种集中式的平台竞争意味着推理工作负载会快速集中在少数几个云基础设施提供商,而不是分散到众多小型服务商。

OpenClaw vs 主流生成式AI应用形态对比:推理芯片需求爆发的链条

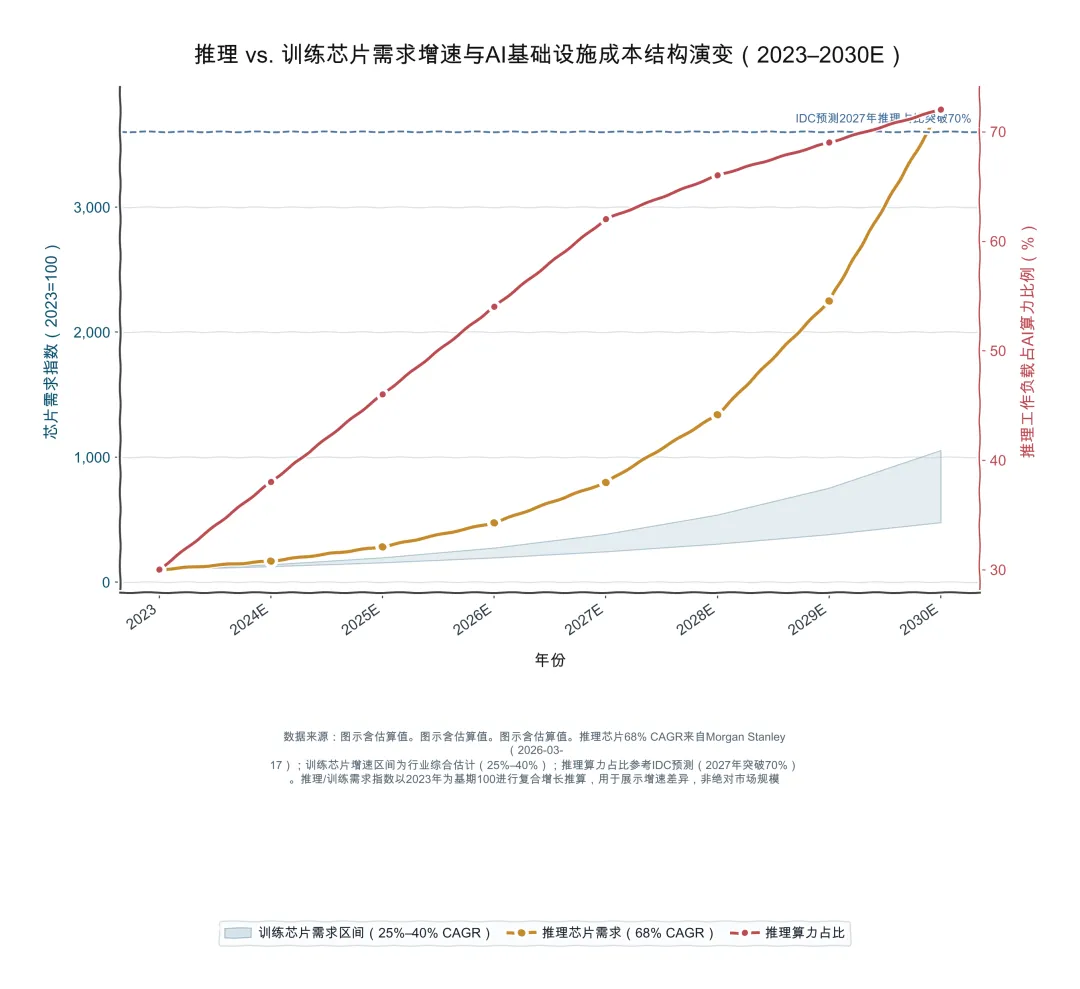

摩根士丹利指出,在云AI领域,推理芯片预期增长68% CAGR(2023-2030年),明显超越训练芯片增速。驱动力很直接:OpenClaw的多步任务执行模式。一个简单的"帮我整理邮件"请求会被分解为多个步骤——理解用户意图、访问邮箱系统、检索相关邮件、分类整理、反馈结果。每个任务的复杂度和token消耗都在量级上升。

OpenRouter的数据显示,周token使用量在一年内增长了约2,200%。Anthropic的年化收入在2026年2月达到$14B,相比2025年增长1,300%。这些数字反映的不仅是用户增长,更重要的是每个用户的使用强度和任务复杂度的提升。摩根士丹利的研报强调,这种增长来自于"代理执行多步任务,推高每任务token数",而非简单的用户数线性增长。

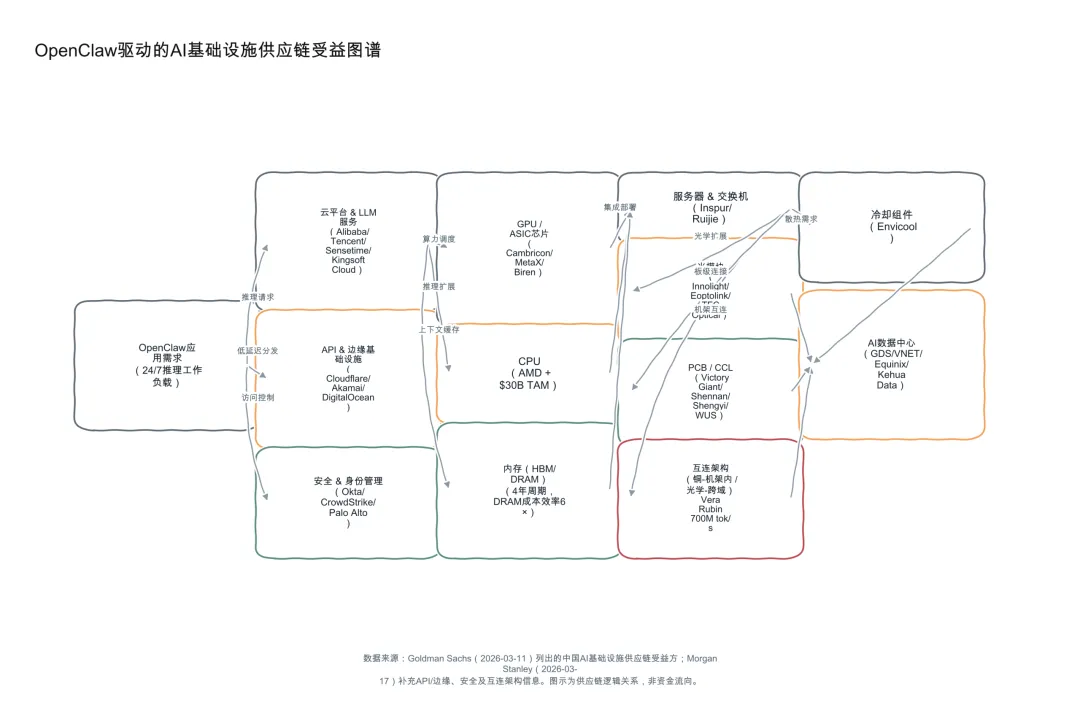

推理需求的增长拉动了GPU和ASIC芯片的需求,更重要的是激活了整个基础设施链条。摩根士丹利明确指出,"推理需求从训练GPU扩展至CPU、内存、网络和低延迟边缘基础设施"。CPU、内存、网络、冷却、数据中心等全链条都面临需求重塑。

AMD的预期进一步验证了这一点。摩根士丹利的研报指出,AMD预计AI将创造额外$30B的CPU需求至2030年,本质上翻倍了CPU的总可寻址市场(TAM)。这反映了推理工作负载对CPU的需求提升,也反映了边缘AI和本地部署对计算能力的新需求。

内存需求的变化尤其值得关注。DRAM周期为4年,而DRAM相比SRAM的成本效率高6倍。在推理工作负载的驱动下,数据中心对大容量、高带宽内存的需求会持续增长。同时,HBM(高带宽内存)仍然是高上下文预填充和大模型工作负载的核心,而SRAM重型LPU则可以补充HBM用于低延迟解码。这种多层次的内存架构意味着内存供应商面临的不是单一产品的需求增长,而是整个产品组合的系统性扩张。

NVIDIA在GTC上的路线图确认了这一多元化趋势。Vera Rubin推理系统能够达到700mn tokens/s的性能,通过7芯片跨5个机架系统实现。Rubin Ultra架构通过单个计算中平面的NVLink连接144个节点,展示了新一代推理基础设施的规模。NVIDIA同时确认了混合互连路线图:铜用于机架内和机架级扩展,光学用于扩展和更大NVLink域。这种多层次的架构设计意味着光学模块、PCB、冷却组件等全链条都面临需求提升。

摩根士丹利进一步指出,这种需求扩张还涉及API/边缘基础设施(Cloudflare、Akamai、DigitalOcean、Fastly)、安全和身份管理(Okta、SailPoint、Palo Alto Networks、CrowdStrike)、数据中心运营商(Equinix、GDS、Kehua Data)等。推理工作负载的增长沿着整个价值链产生系统性拉动。

推理 vs 训练芯片需求增速与AI基础设施成本结构演变(2023–2030):中国的基础设施竞争格局

腾讯、阿里、百度、字节等平台已经拥有身份、通知和日常工作流的入口。OpenClaw的采用集中在那些已经拥有超级应用生态的平台,而非均匀分布在所有云服务提供商。

腾讯通过WeChat的集成能力尤其突出。QClaw可以本地安装,并与个人WeChat账户深度集成,大幅降低了用户的学习成本和迁移成本。阿里通过钉钉的企业工作流优势、百度通过搜索和内容生态、字节通过抖音和今日头条的用户基数,都在争夺OpenClaw的部署入口。这场竞争的本质是争夺推理工作负载的承载权。

高盛列出的受益方包括GPU/ASIC供应商(Cambricon、MetaX、Biren等)、服务器和交换机ODM(Inspur、Ruijie)、光模块供应商(Innolight、Eoptolink、TFC Optical)、PCB/CCL供应商(Victory Giant、Shennan、Shengyi Tech、WUS)、冷却组件供应商(Envicool)、AI数据中心运营商(GDS、VNET Group)以及LLM和云服务提供商(Alibaba、Tencent、Sensetime、Kingsoft Cloud)。

这个供应链的完整性反映了推理工作负载对基础设施的全面拉动。24/7连续服务意味着数据中心需要更高的容量和更稳定的运营。国内GPU/ASIC供应商、服务器制造商、光模块供应商等都处于这一需求增长的直接受益位置。

OpenClaw驱动的AI基础设施供应链受益图谱:云端vs本地存储的基础设施分化

OpenClaw的个人数据库存储存在两条路径:云端存储或本地存储。这个选择直接影响基础设施需求的结构。

云端存储路径会增加光模块、PCB等网络和连接组件的需求。数据需要在用户设备和云端之间持续同步,对网络带宽和延迟提出了更高要求。本地存储路径则会增加服务器、冷却等本地基础设施的需求,但同时也引入了隐私保护和数据安全的新挑战。

中国的监管环境可能会推动本地存储方案的采用。个人信息保护法等政策框架对数据跨境流动有明确限制,这可能改变基础设施需求结构,使得本地存储和边缘计算的需求相对提升。这种政策导向的基础设施分化,为不同类型的供应商创造了差异化的机会。

安全、隐私、监管的制约

OpenClaw的大规模部署面临多维度的风险。个人信息泄露是最直接的风险。系统级访问能力意味着更高的数据暴露风险——一旦代理被攻击或配置不当,用户的文件、邮件、日历等敏感信息都可能被泄露。高盛的研报明确指出,这是OpenClaw大规模部署的关键制约因素。

自主执行的错误成本也不容忽视。文件删除、错误邮件回复、数据上传等操作失误可能触发监管审查和用户信任危机。与传统AI应用不同,OpenClaw的错误不仅是信息错误,而是可能导致实际损失的操作错误。这种风险的存在直接影响用户对OpenClaw的信任度,进而影响采用速度。

监管不确定性是第三个层面的风险。中国对AI应用的监管框架仍在演进,OpenClaw的自主执行特性可能面临新的合规要求。系统级访问权限、数据存储位置、跨境数据流动等都可能成为监管关注的焦点。高盛的研报强调,这些监管风险是当前市场对OpenClaw采用速度预期的重要折扣因素。

平台集中度风险也值得关注。OpenClaw服务集中在腾讯、阿里、百度等少数平台,这可能限制基础设施受益方的多样性,同时加剧平台间的竞争压力。如果某个平台因监管或安全问题被迫暂停OpenClaw服务,整个生态的推理工作负载可能面临突然下降。这种集中度风险对基础设施投资的持续性构成了实质性威胁。

大行的投资逻辑与估值重塑

推理芯片的长期增长确定性建立在OpenClaw驱动的持续工作负载基础上。68% CAGR的增速预期基于OpenAI 20B+的收入增长、周token使用量约2,200%的增长、Anthropic $14B年化收入等具体数据支撑。这些数字反映的是应用形态的根本转变,而不是周期性的需求波动。

基础设施全链条的投资机会超越了单纯的芯片。从GPU/ASIC到CPU、内存、网络、冷却、数据中心,每个环节都面临系统性的需求提升。AMD预计的$30B CPU需求增加、DRAM周期的4年循环、光学模块在混合互连中的扩展应用,都指向一个共识:这一轮基础设施投资周期的规模和持续性可能超出市场预期。

中国市场的竞争优势在于腾讯、阿里等平台的快速集成和用户基数优势。这为基础设施投资提供了强劲的需求支撑。国内GPU/ASIC供应商、服务器制造商、光模块供应商等都处于这一需求增长的直接受益位置。

摩根士丹利和高盛的研报都强调了一个关键判断:当前市场对推理芯片需求增速的预期可能仍然保守。如果OpenClaw的推理工作负载增速持续超预期,基础设施相关公司的TAM和增速预期可能面临向上修正。这种估值重塑的空间,对于那些已经在推理芯片和基础设施领域布局的公司而言,构成了显著的上行潜力。

OpenClaw驱动下AI基础设施各环节TAM扩张(2023 vs. 2030E)

风险与制约的现实性

虽然推理芯片需求的增长逻辑清晰,但实现这一增长的路径并非无障碍。模型选择的互换性可能削弱单一供应商的锁定效应。即使推理工作负载增长,芯片供应商之间的竞争也会加剧,可能压低单位价格。这意味着芯片厂商需要通过成本控制和性能优化来维持盈利能力。摩根士丹利指出,多厂商AI世界可与NVIDIA保持最低token成本共存,这暗示了竞争格局的演变。

内存周期的风险不容忽视。摩根士丹利的研报显示,DRAM合约价格与现货价格出现了前所未有的错配。历史上DRAM周期为4年,当前的价格背离可能预示周期反转。如果DRAM价格在2026年下半年开始下行,这会直接影响内存供应商的盈利能力。这种周期性风险对于依赖内存需求增长的投资逻辑构成了实质性威胁。

Intel的参与程度仍存不确定性。NVIDIA在GTC上未突出NVDA-Intel的实质性联系,反而强化了自有CPU+网络+存储堆栈。Intel的参与更可能通过封装或代工而非核心平台伙伴关系,这限制了Intel在推理芯片浪潮中的直接受益。摩根士丹利明确指出,"近期读数有限",这反映了市场对Intel参与程度的谨慎态度。

安全和监管风险可能打断当前的增长逻辑。如果OpenClaw的安全问题导致大规模用户信任危机,或者监管收紧限制了系统级访问权限,推理工作负载的增长可能面临显著放缓。个人信息泄露、自主执行错误、监管不确定性都是关键制约因素。这些风险的实现概率虽然难以量化,但其影响程度足以改变整个投资逻辑。高盛的研报强调,这些风险是当前市场对OpenClaw采用速度预期的重要折扣因素。

结论

OpenClaw的出现标志着AI应用从被动问答向主动执行的转变。推理芯片68% CAGR的增速、AMD CPU TAM翻倍、全链条硬件需求的系统性拉动,都指向一个共识:这一轮基础设施投资周期的规模和持续性可能超出市场预期。

中国大行对OpenClaw的快速集成进一步强化了这一趋势的确定性。腾讯、阿里、百度、字节等平台的深度集成,为推理工作负载的增长提供了强劲的市场支撑。基础设施供应链的各个环节——从GPU/ASIC到CPU、内存、网络、冷却、数据中心——都处于这一需求增长的直接受益位置。

然而,安全、隐私和监管风险仍是大规模部署的关键制约。投资者需要密切关注三个关键指标:OpenClaw的用户增长和任务复杂度变化、中国主要平台的集成进展和推理工作负载占比、以及监管政策的演进方向。这些指标将直接决定基础设施投资周期的持续性和强度。如果这些风险得到有效管理,基础设施相关公司的增长空间将被重新定义;反之,监管收紧或用户信任危机可能打断当前的增长逻辑。