【研报锐评】人工智能三起两落:读懂这份报告,才算真正理解AI周期律

最近读了一份来自天津大学的AI研究报告,73页干货满满。但真正让我眼前一亮的是几个"反常识"信号——这些观点可能会颠覆你对AI发展惯性的认知。

一、莫拉维克悖论:这个反常识,被大部分人忽略了

报告里提到了一个有趣的悖论:3岁婴儿已经看过数亿张图像、听过数万小时的声音,但这些对AI来说却是最"贵"的计算任务。

报告中指出,模拟人类视觉需要超过1000MIPS的计算力——这在上世纪70年代是当时最强超级计算机的10倍以上。而国际象棋每步可能棋局是10^40,但3岁婴儿的本能感知却需要更恐怖的算力。

反常识点:你以为下棋很难?其实对AI来说,"看见"和"感知"比逻辑推理难一万倍。这个认知差距,解释了为什么AI在专业领域(棋类、计算)早早超越人类,却在感知世界这件事上至今仍是短板。

二、专家系统失败启示录:窄AI的胜利,可能是AGI的陷阱

1980-1987年,专家系统曾让AI行业一片繁荣。XCON专家系统创造了商业价值,YC等汇集人类常识的专家系统相继出现。但1987年后,整个领域再次进入寒冬。

报告里一句点睛:"Elephants Don't Play Chess"——大象不会下棋,但大象比任何国际象棋程序都聪明。

反常识点:专家系统的失败说明,在垂直领域做到极致,并不等于走向通用人工智能。AI需要"身体",需要从对世界的感知中学习智慧——这个观点在2024年的今天看,是不是格外有感触?

三、大模型"军备竞赛"的终点:参数量≠智能

报告梳理了大模型发展简史,从2018年GPT-1的1.17亿参数,到2024年GPT-5即将发布(估计10000亿+参数),参数规模增长了将近10万倍。

但报告中一张图值得深思:从GPT-3到GPT-4,参数规模爆发式增长,但性能提升的曲线其实越来越陡峭——边际效益在递减。

反常识点:不是参数量越大越聪明。Google的Switch Transformer(16000亿)和阿里的M6(100万亿)参数规模惊人,但在实际任务中,OpenAI的GPT-4却依然领先。模型的"聪明程度",更取决于架构创新和训练方法,而非单纯的参数堆砌。

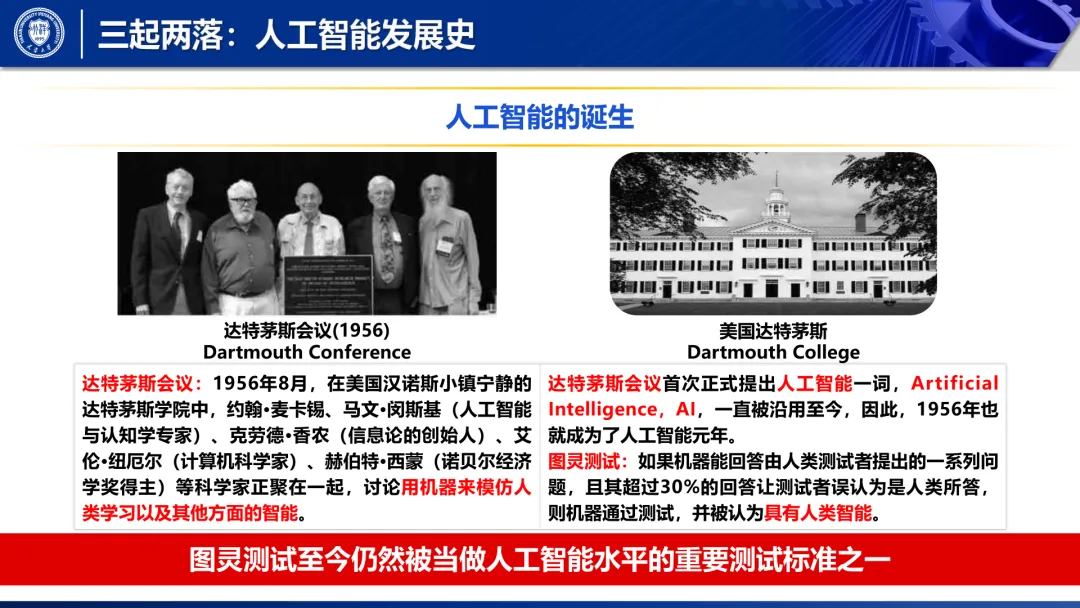

四、寒冬,才是AI真正突破的前夜

报告梳理了三起两落的历史——每次寒冬过后,都伴随着重大技术突破:

- 第一次寒冬(1974-1980)后,Hopfield网络和反向传播算法诞生

- 第二次寒冬(1987-1993)后,CNN和深度学习基础被奠定

- 1993-2015的稳健发展期,迎来了ImageNet挑战赛和深度学习革命

反常识点:当所有人都在谈论AI热潮时,也许更应该关注"AI寒冬"的信号——因为真正的创新,往往诞生于低谷之后的复苏期。

总结:这份天津大学的AI历史报告,最大的价值不是告诉你AI有多热,而是提醒你:每一次技术突破之前,都是漫长的积累期。理解这个周期律,比追逐任何单点技术都重要。

📌 关键词回复"AI周期"获取更多研报解读

文 | 云锦微AGIBox团队 | 研报锐评系列